지난 22일(현지시각) 미국 IT 전문 매체 디 인포메이션(The Information) 등 외신에 따르면, 실리콘밸리 AI 연구의 심장부에서 대형언어모델 개발의 ‘성공 방정식’이 송두리째 흔들리고 있다.

아마존 AGI 랩의 데이비드 루안(David Luan)을 비롯한 주요 연구진과 오픈AI 내부에서는 기존의 ‘선 사전 학습, 후 미세 조정’이라는 관행적 훈련 방식을 폐기하고, 처음부터 특정 목적에 맞춘 데이터를 주입하는 ‘엔드-투-엔드’ 방식으로의 전환을 강력히 주장하고 나섰다. 이는 범용 모델의 비효율성을 걷어내고 기업의 투자수익률(ROI)을 극대화하려는 AI 업계의 새로운 패러다임 시프트이다.

무너지는 ‘사전 학습’ 공식… “코딩 AI가 시(詩)를 배울 이유 없다”

지금까지 LLM 개발의 정석은 인간의 학습 과정과 유사했다. 마치 초등교육처럼 방대한 일반 지식을 먼저 학습(Pre-training) 시킨 뒤, 이후 특정 목적에 맞춰 전문 지식을 가르치는 사후 학습(Post-training) 단계를 거치는 방식이었다. 그러나 초기 오픈AI에서 GPT 시리즈를 개발하고 구글에서 팜(PaLM)을 만든 ‘AI의 전설’ 데이비드 루안 아마존 AGI 랩 책임자는 이 방식에 대해 “오래가지 못할 것”이라며 사형 선고를 내렸다.

루안 책임자는 모델이 코딩이나 고객 환불 처리와 같은 명확한 업무를 수행할 목적이라면, 시(詩) 창작이나 원예 같은 불필요한 지식을 학습하는 데 막대한 컴퓨팅 자원을 낭비할 필요가 없다고 지적했다. 즉, 처음부터 모델의 용도를 정해두고 그에 필요한 선별된 데이터만을 학습시키는 것이 훨씬 효율적이라는 주장이다. 이는 모델이 불필요한 정보의 간섭 없이 목적에 빠르게 적응하게 하며, 자원 낭비를 최소화하는 ‘목적 지향적’ 훈련법이다.

조직도 바꾼다… ‘통합 학습팀’의 부상

이러한 기술적 변화는 AI 기업의 조직 구조까지 바꾸고 있다. 오픈AI와 싱킹 머신즈 랩(TML) 등 선도적인 AI 파운데이션 모델 개발사들은 기존에 분리되어 있던 사전 학습 팀과 사후 학습 팀의 경계를 허물기 시작했다.

연구자들은 데이터 선별부터 최종 최적화까지 하나의 ‘통합 학습팀’이 전 과정을 책임져야 한다고 입을 모은다. 어떤 데이터를 훈련에 투입할지 결정하는 ‘데이터 큐레이팅’ 자체가 모델의 핵심 성능을 좌우하는 노하우가 되었기 때문이다. 이는 범용 모델 하나를 만들어 돌려쓰던 시대에서, 처음부터 기획된 다수의 ‘특화 모델’을 개발하는 시대로의 전환을 의미한다.

‘라우팅 기술’과 ‘ROI’… 전문 모델 시대를 여는 열쇠

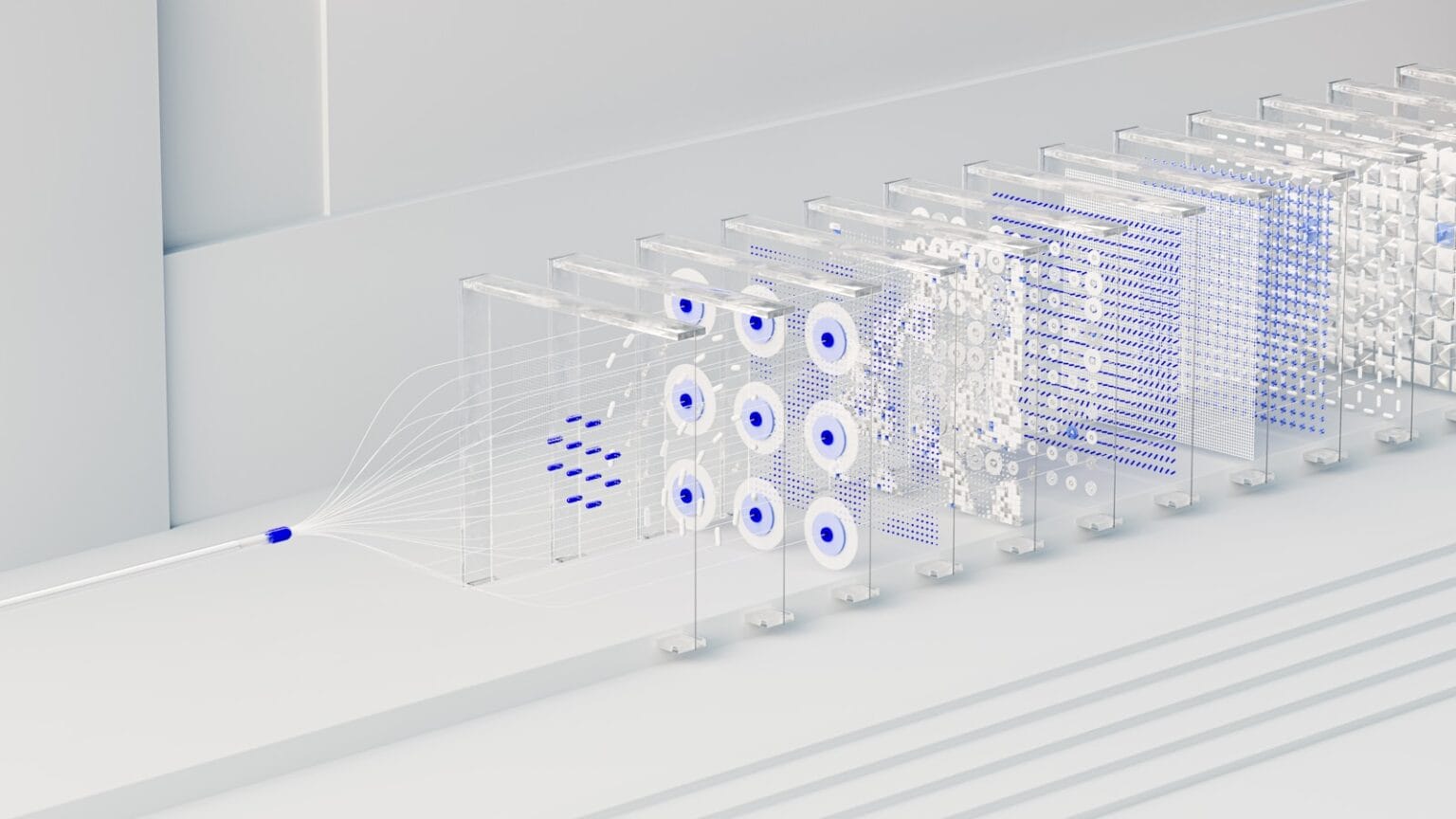

이러한 ‘전문가 모델’ 전략이 힘을 얻는 배경에는 ‘라우팅(Routing)’ 기술의 발전과 ‘투자수익률(ROI)’ 입증이라는 현실적인 요구가 깔려 있다. 라우팅 기술은 사용자의 질문을 분석해 수학 문제는 추론 특화 모델로, 가벼운 대화는 범용 모델로 자동 연결해 주는 기술이다. 오픈AI는 이미 ‘GPT-5’ 개발 과정에서 이 시스템을 도입해 효율성을 입증했다.

또한 올해 AI 업계의 최대 화두가 수익성 입증인 만큼, 기업들은 막대한 비용이 드는 거대 범용 모델보다 특정 도메인에서 확실한 성능을 내는 모델을 선호한다. 실제로 오픈AI가 최근 선보인 모델들이나 출시 예정인 ‘GPT-5.3’ 등이 수학과 코딩에 특화된 것은 이러한 시장의 흐름을 반영한 결과이다. 정답이 명확한 분야에서 가시적인 성능 향상을 보여주는 것이 기업 고객 유치에 유리하기 때문이다.

결국 “모든 것을 적당히 잘하는” 하나의 거대 두뇌보다는, “자신의 분야에서 확실히 뛰어난” 여러 명의 전문가 AI가 협업하는 형태가 미래 AI 생태계의 주류가 될 전망이다.

© 2026 TechMore. All rights reserved. 무단 전재 및 재배포 금지.

기사 제보

제보하실 내용이 있으시면 techmore.main@gmail.com으로 연락주세요.